20世纪90年代以来,人工智能领域下的模拟仿真、机器学习和自主武器取得了极大进展,以“算法战”为代表的智能化战争,在武器平台、作战样式、制胜机理、战争进程等方面呈现出截然不同的特征。如2017年4月,美国国防部成立“算法战跨功能团队”Maven项目,其主要目的在于运用深度神经网络,对无人机传递的视频进行图像分类,从而为国防部处理无人机集群日常所收集的海量战场视频数据。“算法战”的提出,预示着当前信息化战争形态正在由网络化加速向网络化与智能化相结合转变。

智能化战争呈现新特征

全纵深、跨领域的作战空间。从作战空间来看,未来的智能化战争将由传统的单领域、单空间延伸至全纵深、跨领域。传统的陆、海、空、天、网等作战空间的物理界限将会被进一步打破,各作战空间的融合程度将进一步加深。作战空间逐步实现“无缝隙融合”,联合作战依然是其主要作战方式,但其具体形态将由一体化联合作战转变为跨域协同作战。人工智能时代的“跨域协同作战”,将主要包括作战能力跨域融合、作战指挥跨域贯通、作战信息跨域共享、作战平台跨域联通和作战行动跨域响应等因素。

基于算法作战的制胜机理。不同时代的战争,其制胜机理也不同。机械化战争的杀伤模式,是由大规模兵团和坦克“闪击”造成的“面杀”;信息化战争,是利用电磁设备和网络进攻武器进行“网杀”;而智能化战争,是由人工智能武器实施“点杀”。所谓人工智能武器,是指利用人工智能自动追踪、辨别和摧毁敌人目标的武器,通常由信息收集和管理系统、知识库系统、决策辅助系统以及任务实施系统组成。随着人工智能技术的发展,未来的自主武器系统将进一步呈现出无人化、小型化、隐形化和集群化的特征,可对敌方的指挥控制中枢进行精确侦察、监视和打击。

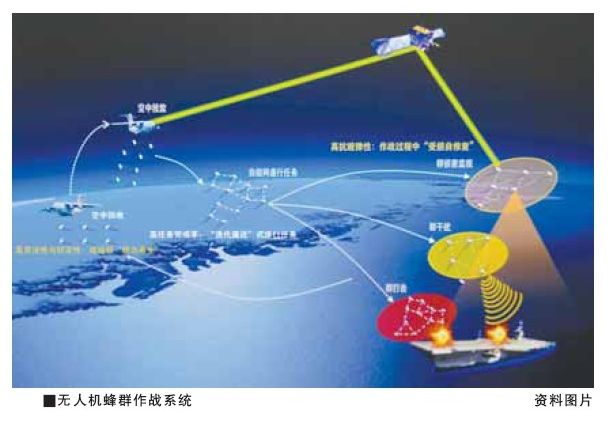

机器人集群化的作战模式。一方面,无人系统集群作战有利于降低战争成本。当前,一架性能先进的无人机售价约为1000美元,一架普通直升机的成本可以折换成数万架无人机。从经济效益来看,无人集群作战或将成为恐怖分子和极端组织实施报复行动的优先选择。另一方面,集群作战方式也有利于国家应对复杂的外部安全威胁。战争早已不是势均力敌国家之间的对称较量,而更多的是非国家行为体非线性或非对称性方式作战。对于己方战争目标而言,除了要打赢战争,还需要进一步减少“战争消耗和战争脚印”,而机器人集群作战将成为应对这些挑战的优先选择。在不久的将来,智能无人系统将与有人系统成为战场“密友”,无人系统独立作战、“无生部队”与“有生部队”混编作战将成为战争新常态。

加速化的战争决策流程。美国空军上校约翰·博伊德曾提出著名的战争决策流程理论,即“观察—调整—决定—行动”(OODA)理论。在国家发生冲突时,谁能够率先完成战争决策的OODA流程,谁就能获得战争主动权。在智能化战争中,机器的自主决策也同样遵循了信息采集、信息分析、决策选择和行动实施四个阶段,但其决策速度要快得多。原因在于:一是改善战场上的态势感知能力。基于人工智能的传感器和处理器能够更好地感知和收集信息,因而简化了决策流程中的第一、第二阶段;二是实现人机协作下的指挥控制,因而简化了决策流程中的第三、第四阶段。在自主系统的协助下,新的指挥控制模式可基于战场的即时态势信息,滚动制定作战计划、动态下达任务指令、适度调控作战行动、精确评估作战效能,在加速既有作战进程的同时,实现作战效果的最优化。

战争智能化伴随安全风险

在智能化战争或将成为新常态的今天,其所伴随的安全风险也必须加以防范。

一是削弱了以核武器为基石的全球战略稳定。冷战时期,以相互确保摧毁为基础的战略稳定性,避免了美苏敌对关系演变为直接军事对抗。冷战结束后,反导式多弹头和导弹防御技术的进步,使建立在核威慑基础上的全球战略稳定遭到削弱。当人工智能技术越来越多应用于战场,无论是单兵式还是集群式自主武器系统,都是基于算法进行自主控制,其攻防界限、侦打界限更加模糊。如使用无人系统来执行侦察行动,有可能被对手误解为是直接攻击;使用无人系统摧毁对方国家的核武器或运载设施,将提升常规冲突升级为核冲突的风险;由于人工智能缩短了战争决策流程,对手做出反应和决策的时间更加短暂,有可能陷入“非应战、即失败”的两难境地。为避免在战争中陷入被动,国家发动首轮攻击的倾向性大大提升了。

二是提高了国家陷入危机升级的安全风险。其主要体现在攻击来源、攻击目标和攻击程度三个方面。从攻击来源看,如果人工智能系统或武器装备一旦被对手通过恶意代码、病毒植入、指令篡改等手段攻击,将引发战斗失败甚至危机升级。从攻击目标看,杀手机器人由于无法区分军人与平民目标,或者无法区分经伪装的军事设施和民用设施,从而导致因误伤引起战争升级。从攻击程度来说,由人类控制的武器系统在战争中的毁伤程度,可通过实战演练呈现出来,而自主武器系统在战场上可进行深度学习和不断更新,其毁伤效果难以通过战前演练准确呈现,因此其冲突规模和暴力程度也难以被人类预判和控制。

三是引发了自主武器系统的军备竞赛。在大国战略竞争愈演愈烈这一国际背景下,鉴于人工智能技术在军事领域的广阔前景,自主武器系统可能深刻改变战争的成本收益对比,极大地降低战争门槛,世界各主要国家陷入人工智能军备竞赛的可能性在不断上升。与核武器和其他高新技术领域的常规武器有所不同,人工智能技术可通过军民融合、军地两用途径不断得到研发和升级,其研究平台更加广泛,获取途径更为多元,因此其“水平扩散”和“垂直扩散”的倾向也更加明显。当前,由于人工智能技术的战略红利依然存在,美、俄、日、印、韩等主要国家已将人工智能视为国家间战略竞争的新战场。尽管国际社会要求停止研发和部署自主武器系统的呼声日益高涨,但目前出台一项全面禁止该武器的国际条约的可行度并不高。

有效安全管控智能化战争

在引发新一轮军事变革的同时,人工智能技术也将给国家带来极大的安全风险。对人工智能技术的“井喷”式发展,应未雨绸缪、提前应对,除了要从战略高度尽快出台相关总体规划,进行顶层设计和重点投入,还要在技术和军控等领域进行风险管控和主动作为,在享受人工智能这把“双刃剑”带来的战略红利时,尽可能规避其安全风险。

展开系统性战略规划,将人工智能视为大国间竞争的“新疆域”。特朗普上台后,已明确将中国视为战略竞争对手。“赢得战略竞争、战胜竞争对手”成为美国制定和实施国防和军事战略的基本思路,其主要手段之一就是对战略空间的竞争,并逐渐将竞争重点从核武器、太空、网络、极地、深海转向人工智能领域。美军已将人工智能视为当前国防战略的重要组成部分,并出台了人工智能战略规划图,如2013年的“无人系统一体化路线图2013—2038”以及2018年的“无人系统一体化路线图2017—2042”,将无人系统视为“第三次抵消战略”的主要支柱。面对美军在人工智能领域的一系列动作,首先我们要正视距离,认识到在这个领域中美两军存在的巨大差距和差异。在实现信息化军队的三个阶段中,中国正处于数字化的初始阶段,离网络化和智能化还有很大距离;而美军正逐步由网络化向智能化过渡。关于人工智能在军事领域的运用,是倾向于武器研发或平台升级,还是战争模拟或兵棋推演,各国间侧重不同。其次要拥有战略自信,通过抢夺战略高地、推进军事创新,力求尽早实现“弯道超车”。人工智能技术已经成为未来军力发展的“赋能器”和“增效器”,我们应把握先机,跟踪掌握大数据、云计算、人工智能等先进技术发展前沿,推进与人工智能相关的军事理论和战役战法研究。如在充分研究“算法战”的基础上,推出我军特有的作战概念,并持续推动下一代人工智能技术向指挥决策、军事训练、国防装备等领域的渗透,尽可能地缩小与美国在军事实力上的“代差”。

进行技术性安全设置,限制自主武器系统的附带损伤程度。当前,自主武器系统在战场上的广泛应用,已经对现有国际武装冲突法中的区别、对称和人道主义原则构成了严重冲击。由于缺少主观意识,机器人杀手也难以承担战争中的问责问题。如果将人工智能技术“无限制”地应用于战场,除了会面临国际人道主义危机,也会使国家面临“自我毁灭”的风险。因此在研制人工智能武器时,应在技术上设置“红线”,一方面明确限制此类武器的攻击目标和攻击途径,尽可能控制此类武器的附带损伤程度;另一方面,为走向战场的人工智能武器设置“后门”式自毁模式,可在必要情况下让自主武器彻底死机或报废,使人类操作员在远离战场的情况下也能实现远程控制。

完善国内相关审查制度,确保新型自主武器的合法性与合理性。及时、明确地统一自主武器系统的概念界定与适用范畴,审查自主武器系统的损伤规模、火力配置是否与军事目标相匹配,并审查自主武器的研发与采办是否符合国际人道法的区分和对称原则。所谓区分原则,是指该武器是否能够区分战斗和非战斗人员;所谓对称原则(或称“罚当其罪”),指的是武器对战斗人员造成的伤害不应该超过军事层面的必要程度。除了制度审查,还要尽早明确人工智能武器在武器装备体系中的战略地位,将其划归为包括太空、网络、核武器在内的战略性武器,确保总部机关对该类武器的顶层监管、控制和使用权限。

推动外交军控议程,树立中国负责任的大国形象。积极主动地推动联合国框架下致命性自主武器系统的军控谈判议程,积极参与并推动联合国有关机构和部门组织的相关军控活动,深入详尽地探讨人工智能武器对国际人权法和人道主义法构成的严峻挑战,主动派出专家参与联合国人权理事会召开的专家组活动,并尽快推动设立在日内瓦的裁军谈判会议作为唯一的多边裁军谈判机构,商讨关于此类武器的管制办法,并形成有关年度工作计划,适时提交相关军控专题工作报告,以此提升中国在致命性自主武器系统领域的全球治理能力。

(作者单位:军事科学院;火箭军某部)